Robotok, mindenhol robotok! – Avagy az elektronikus létformák és elméjük, a mesterséges intelligencia problematikája és ennek szellemi tulajdonjogi vetületei

A Copy21 virtuális hasábjain egy bejegyzés erejéig már foglalkoztam a számomra roppant érdekes mesterséges intelligencia témakörével. Abban a bejegyzésben bemutattam Ross-t, a „mesterségesen intelligens ügyvédet”, aki képes arra, hogy olvasson, értsen és hipotéziseket állítson fel a begyűjtött adatok alapján. E képességek lehetővé teszik, hogy a robot jogeseteket oldjon meg a betáplált tényállás és a hozzáférhető jogi adatbázisok segítségével. E bejegyzésben igyekszem továbbgondolni Ross példáját és némi képet vázolni arról, hogy milyen irányba is tart a mesterséges intelligencia és annak jogi megítélése. A poszt a DANUBIA Szabadalom, Védjegy, Design oldalon jelent meg.

Etikus és jogszerű gépek?

A robotizáció és a mesterséges intelligencia (artificial intelligence, AI) számos dilemmát magában hordoz. Létéről számos, vele foglalkozó tudományágnak megvan a pozitív, vagy negatív véleménye, ahogyan a géntechnológia, úgy a gépek evolúciója is felvet etikai és jogi kérdéseket. Vajon hogyan kell egy masinának az alkotói felé viseltetni, és fordítva? Egyáltalán értelmezhető-e utóbbi kérdés, vagyis hordozhatnak-e bármiféle jogi értelemben vett személyiséget a gépek, illetve mi az a határ, amelytől már személyiségről beszélünk? A belátási képesség talán? Képes egy robot belátni? Képes belátni, hogy egy adott cselekvéssel másnak – akár egy természetes, akár egy jogi személynek kárt okoz?

A robotizáció és a mesterséges intelligencia (artificial intelligence, AI) számos dilemmát magában hordoz. Létéről számos, vele foglalkozó tudományágnak megvan a pozitív, vagy negatív véleménye, ahogyan a géntechnológia, úgy a gépek evolúciója is felvet etikai és jogi kérdéseket. Vajon hogyan kell egy masinának az alkotói felé viseltetni, és fordítva? Egyáltalán értelmezhető-e utóbbi kérdés, vagyis hordozhatnak-e bármiféle jogi értelemben vett személyiséget a gépek, illetve mi az a határ, amelytől már személyiségről beszélünk? A belátási képesség talán? Képes egy robot belátni? Képes belátni, hogy egy adott cselekvéssel másnak – akár egy természetes, akár egy jogi személynek kárt okoz?

Egy robot önmagában, önállóan csak akkor lehet alanya bármilyen jogviszonynak, ha jogképes és cselekvőképes. A jogképesség e sorok szerzőjének olvasatában egy tisztán a jogalkotó által megkonstruált kategória. Az embert az élve születésétől kezdve megilleti, illetve a méhmagzat függő jogi helyzetben várhatja, hogy élve születik-e majd, hiszen fogamzása pillanatára nézve visszahatóan jogképes, amennyiben élve születik. Egy robotra ez igaz? Aligha. Bár kétségtelen, hogy a jogalkotó adott esetben felruházhatná valamiféle jogi személyiséggel a gondolkodó mérnöki csodákat, ahogyan tette azt a gazdasági társaságokkal, végső soron a valamilyen cél szolgálatába állított vagyontömeggel.

Sokkal érdekesebb kérdés, hogy egy robot cselekvőképes-e. Ross példájából és sok más ismert példából úgy tűnhet, hogy egy mesterséges intelligenciával ellátott technikai „létforma” igenis képes lehet arra, hogy önállóan cselekedjen. Ma azonban még minden bizonnyal hiányzik annak lehetősége, hogy a tettei következményeit belássa, vagyis mai fogalmaink szerint cselekvőképtelen. Hogyan kellene tehát egy jogképességgel és cselekvőképességgel nem rendelkező, de mégis cselekvő létformára szabályokat írni? Kik felelnek egy robot károkozásáért? Illetve megfordítva, okozhat-e egy ember kárt egy robotnak?

A robotika törvényei

Isaac Asimov Én a robot című könyvében lefektetett törvényei a robotikára a következőket mondják ki:

1. A robot nem árthat az emberiségnek és nem nézheti tétlenül, hogy bármilyen veszély az emberiséget fenyegesse.

2. A robot nem tehet kárt emberi lényben és nem nézheti tétlenül, hogy egy emberi lényt bármilyen kár ér.

3. A robotoknak engedelmeskedniük kell az emberek parancsainak, kivéve, ha ezek az utasítások az első parancsba ütköznek. (Elöljárója parancsát megtagadó robotok?)

4. A robot saját védelméről gondoskodni tartozik, olyképpen, hogy ezzel nem sérti az első és a második törvényt.

Mark W. Tilden a robotok embereknek és emberiségnek való alávetettségét némiképp árnyalja, már-már anarchista, a robotok uralta világot festve.

- A robotnak minden körülmények között meg kell védenie önmagát.

- A robotnak meg kell szereznie és meg kell tartania mindazon erőforrásokat, amelyek működéséhez szükségesek.

- A robotnak folyamatosan jobb erőforrások után kell kutatnia.

A problémakör szabályozásában a világ azon szegmensei járnak az élen, ahol a regulázást a fejlesztés és fejlődés maga után vonja. Dél-Koreában már 2007-ben olyan etikai kódexen dolgoztak futurológusok és sci-fi írók, amelyek a robotokkal való együttélést hivatottak szabályozni.

Bolygónk nyugati felén is foglalkoznak jogászok, mérnökök a kérdéskörrel. Az MI-ket ma arra próbálják meg tanítani, hogy tanuljanak a tapasztalataikból. Ez jól jöhet az önvezető autóknál, a közlekedést irányító okos lámpáknál és jelzéseknél, illetve a Ross-hoz hasonló analizáló és „jogesetmegoldó” robotoknál. De ha egy robot tanul saját maga tapasztalataiból, akkor egyúttal eltávolodik a jogi felelőssége az MI-t készítő programozóétól? Van egy olyan pont, amikor egy robot olyannyira önállóvá válik, hogy az általa tanult új információ, megszerzett tapasztalat elválik az alkotótól és kikerül annak ellenőrzése alól?

Jelenlegi tudásunk szerint kétséges e megállapítás, hiszen ha kellékszavatosság már nem is áll fenn a szoftver fejlesztője esetében, az okos autót, okos közlekedési lámpákat és jeleket továbbra is üzemben tartja egy természetes vagy jogi személy, tehát a felelősség még mindig „emberi”.

Ebben a körben alkalmazható lenne a szerződésen kívüli felelősségre irányadó szabályozás (pl. a 85/374/EGK irányelv), ha a robot gyártási hibája miatt állt be a káresemény és a károsult bizonyítani tudja a tényleges kárt, a termék hibáját és a hiba, valamint a kár közötti okozati összefüggést (objektív felelősség).

De mi van akkor, ha mind a szoftverfejlesztő, mind pedig az üzembentartó úgy járt el, ahogy az adott helyzetben általában elvárható és a káresemény amiatt következett be, hogy a robot „önállósította magát”? Erre a jogalkotónak választ kell találnia. Még akkor is, ha ma a jog nem szabályozza a nem emberi magatartásformákat, mint amilyen például egy méh csípése vagy egy kóbor kutya támadása.

Az Európai Parlament Jogi Bizottsága jelentéstervezetében szintén foglalkozott az androidokkal, botokkal, mesterséges intelligenciával. A jelentéstervezetben annak készítői megjegyzik, hogy 2010 és 2014 között az értékesített robotok száma 17%-kal, míg 2014-ben 29%-kal nőtt, a robottechnológiával kapcsolatos szabadalmi bejelentések száma pedig az utóbbi évtizedben a háromszorosára emelkedett. Ez az emelkedés növekvő tendenciája ellenére az Unió illetékesei szerint az alábbi pozitív és negatív hatásokat hordozza magában:

- A robotikának köszönhetően előretörés várható az orvoslásban, az oktatásban, a közlekedésben, a termelésben és kereskedelemben, valamint a mezőgazdaságban.

- Ugyanakkor veszélyezteti a fennálló társadalmi rendet, hiszen munkahelyek szűnhetnek meg az automatizáció következtében, az erőforrások és befolyás növekedése bizonyos csoportoknál még inkább kiélezheti a társadalmi egyenlőtlenségeket.

- A fizikai biztonság, a programhibák, a programok feltörése súlyos következményekkel járhat.

- Az MI túlhaladva az emberi gondolkodást és teljesítőképességet, már fajunk létét fogja veszélyeztetni.

Az Alapelvek körében a Jelentéstervezet két, számunkra fontos megfogalmazással él. Egyrészt kimondja, hogy„addig a pillanatig, amikor a robotok saját erejükből vagy alkotóik segítségével öntudatra nem ébrednek, Asimov törvényeit úgy kell tekinteni, hogy azoknak a robotok tervezői, gyártói és üzemeltető a címzettjei, mivel ezek a törvények nem alakíthatók át gépi kóddá.” Másrészt úgy rendelkezik, hogy „a robotika és a mesterséges intelligencia fejlődése terén elért szintre tekintettel helyénvaló fontolóra venni a polgári jogi felelősség kérdéseit, és mérlegelni, hogy esetleg nem a legjobb kiindulási pont az az objektív felelősségi megközelítés, amely azon alapszik, hogy ki van a biztosítás szempontjából legkedvezőbb helyzetben.”

A Parlament javasolja a Bizottságnak, hogy dolgozza ki a fejlett robotok és alkategóriáinak pontos fogalommeghatározását, vezessen be nyilvántartási rendszert és besorolási kritériumokat. A felelősségi alakzatok körében a Javaslattervezet a leghelyesebb útnak azt tartja, „ha a megtérítendő károk típusai és mértéke nem korlátozzák a károsultnak felkínálható kártérítés formáit pusztán azon az alapon, hogy a kárt nem emberi lény okozta.” A káresemény beálltáért fennálló felelősségnek objektívnek kell lennie, így elég csak azt bizonyítani, hogy a kár bekövetkezett és fennáll az okozati összefüggés a robot károkozó magatartása és a kár között. „A felelős felek azonosítása után felelősségüknek arányosnak kell lennie a robotnak adott utasítások tényleges szintjével és a robot önállóságával, így minél nagyobb a robot tanulási képessége vagy önállósága, annál kisebbnek kell lennie a többi fél felelősségének, és minél hosszabb ideig tartott a robot „oktatása”, annál nagyobb az „oktató” felelőssége.” A felelősség telepítésének egy lehetséges megoldása a Javaslattervezet szerint egy kötelező biztosítási rendszer bevezetése lenne, amelyben a gyártó kötne biztosítást az általa gyártott autonóm robotokra. (24-29. pont)

A fenti fejtegetések és a szabályozásra tett kísérletek egyelőre még pont abban a fejlődési stádiumban vannak, mint a robotika: ígéretesek, magukban hordozzák a jövőt, de ma még kiforratlanok. Ebből pedig következik, hogy amennyiben egy robot kárt okoz, akkor a polgári jog szabályai szerint vagy az üzembentartója felel érte, vagy pedig, ha tovább tudja hárítani a felelősséget, akkor az ágenst készítő szoftverfejlesztő. Ugyanígy egy bűncselekmény elkövetője sem lehet egy MI, legfeljebb az elkövetés eszköze, vagyis a jogi felelősséget továbbra is a természetes személy viseli.

A téma vitathatatlan időszerűségét és a szellemi tulajdon szempontjából való relevanciáját az is mutatja, hogy a Licensing Executives Society International (LESI) 2017. évi párizsi éves konferenciáján az első nap plenáris ülésének egyetlen szakmai témájaként a teljes délelőttöt a mesterséges intelligencia és annak szellemi tulajdon, technológia-transzfer aspektusai töltötték ki. A mesterséges intelligenciát a plenáris ülés négy szempontból értékelte: a) a tudás keletkezése, b) a tudás védelme, c) a megvédett tudás körüli jogviták és a tudás transzfere olyan környezetben, ahol mind a négy előbbi aspektus tekintetében a főszerepet a mesterséges intelligencia játssza. A mai jog szerint a találmány alkotója csak természetes személy, ember lehet. A LESI konferencián lejátszott, a Watson nevű szoftver bemutató videója alapján látható, hogy ez az állítás már nem sokáig lehet igaz, és hamarosan méltánytalan előnyhöz juthat az az ember, akit feltalálónak minősítenek csak azért, mert gép ilyen minőségben nem ismerhető el. A tudás védelmét az Európai Szabadalmi Hivatal munkatársa előadása szerint egyre több szempontból támogatja a mesterséges intelligencia. Fentebb láthattuk, hogy még a jogviták elintézésében is egyre nagyobb szerep jut a gépeknek: már ma is rendelkezésre állnak a piacon olyan szoftverek és adatbázisok, amelyek egy globális jogvita adatai birtokában képesek „best of” érveket generálni a perbeli képviselet támogatására. Végül, ami a technológia-transzfer ügyleteket illeti, amennyiben az üzleti döntéstámogató rendszerek a mesterséges intelligencia irányában mozdulnak el, és miért is ne ez történne, hamarosan tanúi lehetünk egy gépek által vezérelt innovációs láncolatnak.

Dr. Harkai István

Források:

https://techcrunch.com/2017/01/28/artificial-intelligence-and-the-law/

http://www.europarl.europa.eu/sides/getDoc.do?pubRef=-//EP//NONSGML%2BCOMPARL%2BPE-582.443%2B01%2BDOC%2BPDF%2BV0//HU

http://news.bbc.co.uk/2/hi/technology/6425927.stm

www.ibm.com/watson

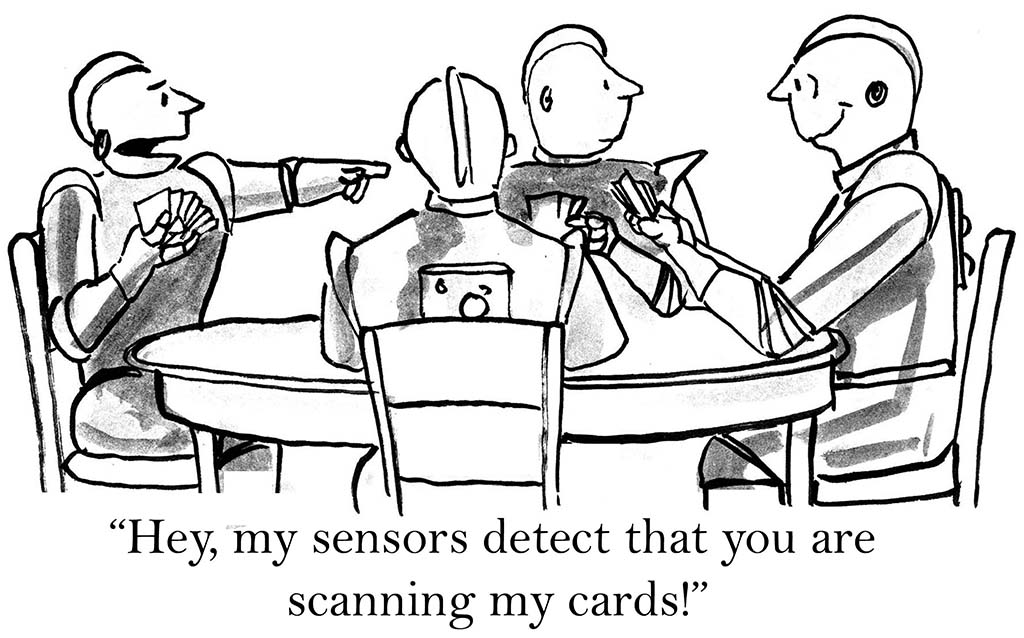

Kép:

http://www.pitara.com/wordpress/wp-content/uploads/2004/11/what-is-artificial-intelligence.jpg